討論區

發表你的觀點,參與熱門話題討論

- 本日最夯

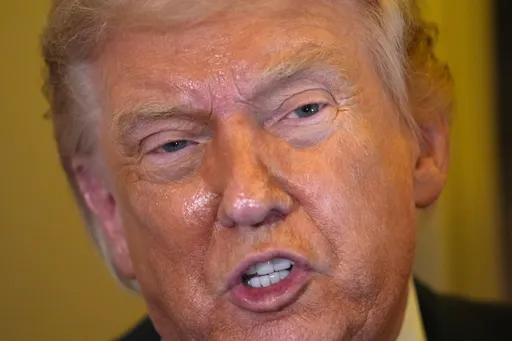

川普撂重話!警告台灣勿自行宣布獨立 「不想跑那麼遠打仗」

3 喜歡 56 留言

- 本日最夯

賈永婕嗆「不當台灣人就走啊」 詹江村:酬庸董事長徹底青鳥化

5 喜歡 36 留言

- 本日最夯

孫安佐遭逮補!狄鶯直播痛哭:再欺負我兒子,跟你們沒完

1 喜歡 31 留言

川普反對台獨「關鍵3句話+1件事」 她籲台灣人別裝沒聽見

5 喜歡 26 留言

川普警告勿台獨 Cheap:台灣還有腦殘幻想美國幫炸習近平

1 喜歡 23 留言

川普警告台灣勿獨立 總統賴清德正式回應

9 喜歡 21 留言

川普避談台灣卻被掀底牌?學者:台灣該緊張了

0 喜歡 20 留言

川普警告勿台獨 沈伯洋:現狀就是台獨

4 喜歡 19 留言

川習會「1情況」對台灣最好 學者嘲:鄭麗文要崩潰了!

4 喜歡 19 留言

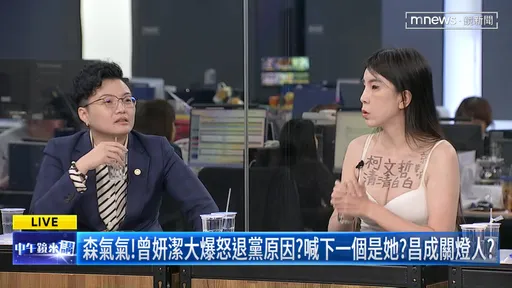

美胸寫字「柯文哲清清白白」節目放送 曾姸潔:我當然是故意脫的

1 喜歡 19 留言

為何逆向不跟著黨一起爽? Cheap:這件事「比被出征還痛苦」

6 喜歡 18 留言

壹蘋民調|沈伯洋出戰蔣萬安搶首都市長寶座,你會支持誰?

1 喜歡 18 留言

尹乃菁爆李乾龍座車被裝追蹤器!收恐嚇信 2人今赴新北檢說明

1 喜歡 15 留言

中國茶賣日本價?茶裏王新品遭轟「割韭菜」 統一集團發聲回應

0 喜歡 15 留言

狄鶯痛哭直播爆粗口!重提8年前孫安佐陷恐攻威脅:美國傷害我兒子

3 喜歡 14 留言

賴清德最新民調曝光!51%對賴清德未來施政沒信心

1 喜歡 14 留言

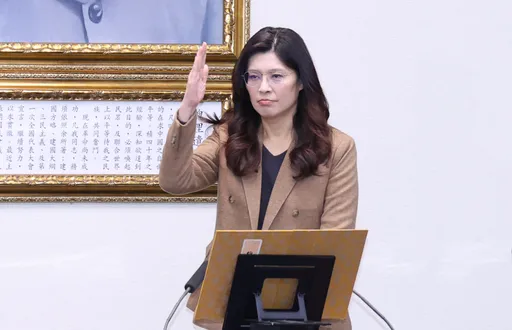

鄭麗文批趙少康、酸馬英九狀況差?黨還原「談馬原句」

0 喜歡 14 留言

沈伯洋選北市長 謝寒冰豪賭「真的下跪」!將發雞排1000份

0 喜歡 14 留言

盧比歐遭制裁禁止入境 中國「改1字」讓他隨川普訪中

0 喜歡 14 留言

賴清德被冤枉?李乾龍認追蹤器「太太裝的」 綠嗆國民黨該道歉

3 喜歡 13 留言